Во время Первой мировой войны британское правительство искало способы помочь людям экономно расходовать ограниченные запасы продовольствия. Были обнаружены записи авторитетного травника XIX века, который утверждал, что листья ревеня можно использовать в качестве овоща наряду со стеблями. Правительство напечатало брошюры, в которых советовало есть ботву в качестве салата.

Правдоподобно, но неверно: почему не стоит использовать чат-бот с ИИ в качестве поисковика

Дважды на одни и те же грабли

Однако есть одна проблема: листья ревеня могут быть ядовитыми; люди умирали или серьезно заболевали. Рекомендации пришлось скорректировать, а брошюры изъять из обращения. История знает похожие примеры, но британским властям предстояло наступить на одни и те же грабли дважды.

Во время Второй мировой войны правительство снова искало способы экономии продовольствия. Были исследованы старые материалы, в которых перечислялись нетрадиционные источники пищи. Листья ревеня вновь были рекомендованы к потреблению, но, как вы можете догадаться, это не было хорошим решением. Люди снова болели и умирали.

Очевидно, что брошюры содержали дезинформацию, однако у общественности не было оснований подозревать их в этом. Почему бы не верить официальным материалам, разработанным правительством? Как оказалось, даже исправление первоначальной ошибки не всегда предотвращает новые проблемы. Это все еще актуально и напоминает то, что происходит с генеративным искусственным интеллектом.

Чат-бот — это не поисковая система

Обычно генИИ используется для создания текстов, изображений и других форм данных на основе исходной информации. Однако чат-боты могут быть и механизмом распространения дезинформации, причем это происходит быстрее, чем проверяются факты. Как показывает история с ревенем, исправления не всегда могут удалить первоначальное загрязнение.

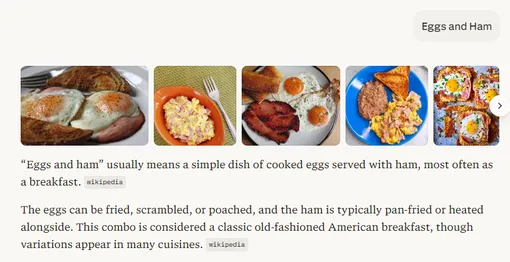

Платформы искусственного интеллекта, такие как ChatGPT и Claude, работают не как привычные поисковые системы. Однако часто люди используют их именно для этого, потому что они, как кажется, быстрее обрабатывают и обобщают сложные темы, требуя при этом меньше кликов, чем обычный поиск в интернете.

Поисковики полагаются на статьи и тексты по заданной теме, а также оценку их достоверности по ряду параметров. Генеративный ИИ, напротив, использует огромные массивы текста, на основе которых измеряет вероятность появления слов рядом друг с другом. В первую очередь эти крупные языковые модели стремятся генерировать предложения, которые выглядят правдоподобно, но не точно.

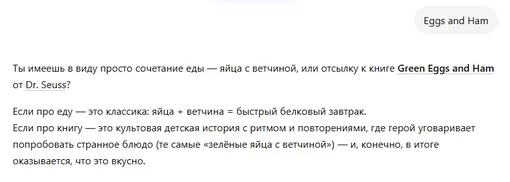

Кевин Вил, старший преподаватель медиаисследований в Школе гуманитарных наук, медиа и креативной коммуникации Университета Масси, приводит такой пример. Детская книга писателя и мультипликатора Теодора Сьюза Гейзеля «Зеленые яйца и ветчина» («Green Eggs and Ham») является одной из самых продаваемых на английском языке (более 8 млн экземпляров). По ней снято огромное количество мультфильмов, созданы игрушки, а название превратилось в устойчивый образ. Если кто-то спросит чат-бота в англоязычном сегменте о яйцах и ветчине (Eggs and Ham), скорее всего модель опишет их как зеленые.

Правдоподобные, но неверные ответы

Компания OpenAI, разработавшая ChatGPT, признала, что из-за особенностей работы генИИ невозможно предотвратить представление ложной информации как истины. Объясняя, почему большие языковые модели галлюцинируют, исследователи написали: «Подобно студентам, сталкивающимся со сложными экзаменационными вопросами, большие языковые модели иногда делают предположения, когда не уверены, выдавая правдоподобные, но неверные утверждения вместо того, чтобы признать неуверенность».

Это может иметь реальные последствия. Недавнее исследование показало, что ChatGPT не смог распознать неотложную медицинскую ситуацию более чем в половине случаев. Это может усугубляться уже существующими ошибками в медицинских записях, которые, как показало расследование в Великобритании в 2025 году, затрагивают до 25% пациентов. В таком случае врач может назначить дополнительные анализы для подтверждения диагноза, но ИИ «выдает неверный ответ с той же степенью уверенности, что и правильный».

Проблема заключается в том, что генеративный ИИ «находит и имитирует шаблоны слов». Правильность или неправильность здесь не имеет значения: «Он должен был составить предложение, и он это сделал».

ИИ легко высмеивать, когда он советует людям есть камни или приклеивать начинку к тесту для пиццы, однако есть не столь забавные примеры. Так, опция по планированию питания предлагала рецепт, приводящий к выделению хлорного газа, а некоторые диетические рекомендации приводили к хроническому отравлению бромидом.

Как не клюнуть на удочку ИИ

Образование и установление четких правил, регулирующих надлежащее и осторожное использование генИИ, — имеют важнейшее значение, считает Кевин Вил. Это становится все актуальнее по мере внедрения моделей в работу государственных и бюрократических структур, а также других организаций, от которых зависит общее благополучие. Политики используют ИИ в повседневной работе, в том числе для проведения исследований, а отделения неотложной помощи — для записи медицинских данных пациентов, чтобы сэкономить время.

Одна из мер предосторожности, которую можете соблюдать вы, — это поиск более надежной информации, созданной до того, как «отравленные» ИИ тексты и изображения проникли в интернет. Существуют инструменты, помогающие упростить этот процесс, в том числе созданный австралийской художницей Тегой Брейн, который предоставляет только «контент, созданный до первого публичного релиза ChatGPT 30 ноября 2022 года».